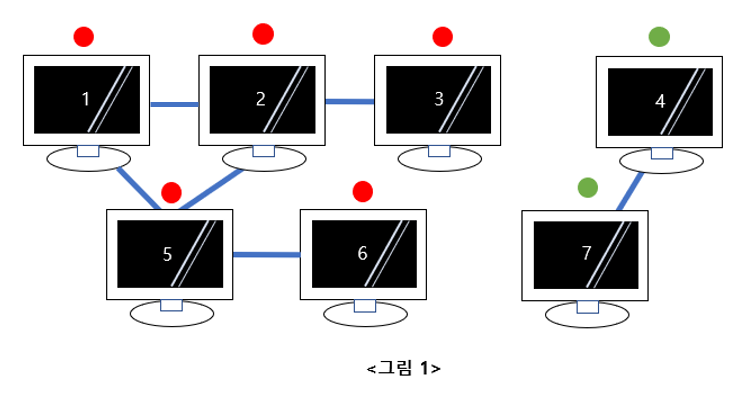

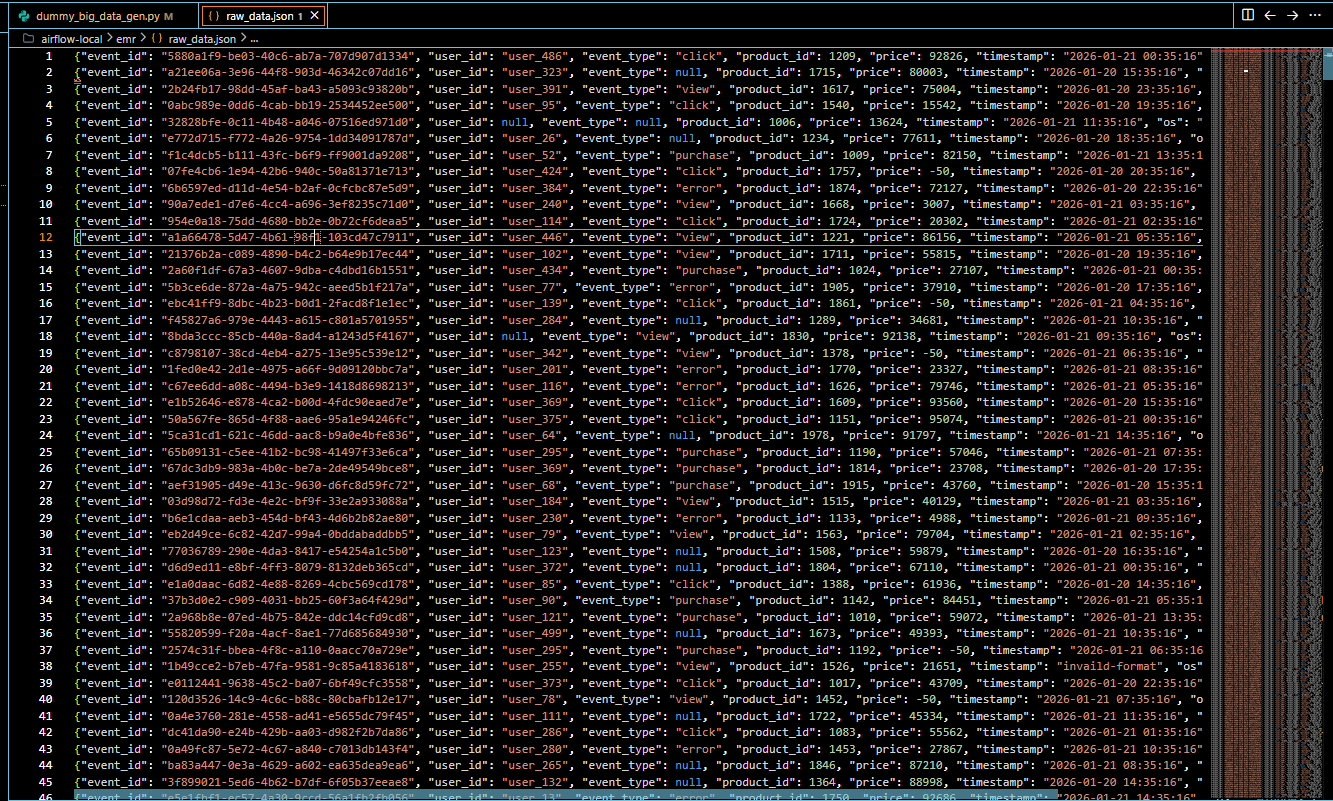

메인 프로젝트 전 마지막 미니 프로젝트를 진행하였다. 이번 미니프로젝트는 데이터 파이프라인에 관심이 많은 분이 하고싶으신 방향이 있다고 해서 주제를 정했고 프로젝트 내부에도 LLM관련된 파트가 있어서 내가 그 파트를 맡기로 하게 되었다. 우리 프로젝트의 메인 주제는 수업 내용인 시간을 정해두고 자동화 하는 부분보다 높은 기술을 구현하는것으로 실시간으로 데이터를 파싱하여 슬랙에 전송, 대시보드에 띄우기, 등의 작업들을 "실시간"으로 처리하는데에 의의가 있다. 인프라 구축, 파이프라인 구성 등에서 일반적인 프로젝트보다 훨씬 난이도가 있고 볼륨이 큰 내용이라서 큰 도전이지만 바이브코딩과 팀원들을 믿기에 수행할 수 있었다. 프로젝트의 개요부터 차근차근 시작하겠다. 프로젝트 명: CALI (Cloud-native..